Jeszcze kilka lat temu pozycjonowanie stron sprowadzało się do prostej recepty: zadbaj o techniczne podstawy, zbuduj linki, napisz treści z właściwymi frazami i czekaj na efekty w Google. Ta formuła działała sprawnie przez ponad dwie dekady. Dziś jednak krajobraz wyszukiwania zmienia się szybciej niż kiedykolwiek wcześniej — i to, co wystarczało w 2022 roku, w 2026 roku może okazać się zdecydowanie niewystarczające. Sztuczna inteligencja wkroczyła do wyszukiwarek nie jako dodatek, lecz jako nowa warstwa, która fundamentalnie zmienia sposób, w jaki użytkownicy znajdują informacje, a firmy — swoich klientów. Google AI Overviews dociera już do ponad 2 miliardów użytkowników miesięcznie, ChatGPT obsługuje 800 milionów tygodniowo, a Perplexity przetwarza setki milionów zapytań w tym samym czasie. To nie są liczby z odległej przyszłości — to rzeczywistość, w której funkcjonuje Twoja strona internetowa już teraz. Jeśli Twoja strategia marketingowa nie uwzględnia pozycjonowania AI, istnieje realne ryzyko, że tracisz widoczność w miejscach, gdzie Twoi klienci coraz częściej szukają odpowiedzi na swoje pytania.

Podsumowanie najważniejszych punktów

- Ponad 58% wyszukiwań w Google kończy się dziś bez kliknięcia w jakikolwiek link — zero-click searches to nowa norma, z którą musi liczyć się każda strategia SEO.

- Algorytmy generatywne (ChatGPT, Gemini, Perplexity) rekomendują znacznie mniej firm niż tradycyjny Local Pack Google — ChatGPT zaledwie 1,2% lokalizacji, co oznacza ogromną lukę widoczności dla firm nieobecnych w GEO.

- GEO (Generative Engine Optimization) nie zastępuje klasycznego pozycjonowania stron — uzupełnia je o nowy wymiar optymalizacji pod silniki generatywne.

- 86% cytowań w odpowiedziach AI pochodzi ze źródeł kontrolowanych przez markę — własna strona i profile w katalogach branżowych mają kluczowe znaczenie dla cytowalności.

- Zasada „answer-first", krótkie akapity, sekcje FAQ i klastry tematyczne to fundamenty treści przyjaznych algorytmom AI.

- Schema markup w formacie JSON-LD — szczególnie typy FAQ, Article, Organization i LocalBusiness — bezpośrednio zwiększa szanse na pojawienie się w odpowiedziach generatywnych.

- Blokowanie crawlerów AI (GPTBot, ClaudeBot, PerplexityBot) w pliku robots.txt skutkuje całkowitą niewidocznością w odpowiedziach danej platformy — to jeden z najłatwiejszych do naprawienia błędów.

- Pomiar efektów GEO wymaga nowych metryk: cytowań w AI, share of voice, sentymentu wzmianek i ruchu referral z platform generatywnych śledzonego w GA4.

Jak AI zmieniło krajobraz wyszukiwania?

Przez lata strona wyników wyszukiwania Google wyglądała niemal identycznie: kilka reklam na górze, dziesięć organicznych wyników, może featured snippet i ramka z mapami dla lokalnych zapytań. Użytkownik wpisywał frazę, przeglądał listę linków i klikał w ten, który wydawał mu się najbardziej obiecujący. Cały ekosystem SEO był zbudowany wokół tej jednej, prostej interakcji. Dziś ta interakcja ulega głębokiej transformacji. Generatywna sztuczna inteligencja wbudowana bezpośrednio w wyszukiwarkę potrafi nie tylko wskazać stronę z odpowiedzią, ale samodzielnie tę odpowiedź sformułować — syntetyzując informacje z dziesiątek źródeł i prezentując gotowy tekst użytkownikowi jeszcze przed pierwszym tradycyjnym wynikiem organicznym. To zmienia wszystko: sposób, w jaki treści muszą być pisane, jak strony muszą być skonstruowane i jak firmy powinny myśleć o swojej widoczności w sieci. Tradycyjne metryki — pozycja w rankingu, liczba kliknięć, CTR — zaczynają tracić na znaczeniu jako jedyne mierniki sukcesu. Pojawiają się nowe pojęcia, nowe narzędzia i nowe strategie. Żeby zrozumieć, co tak naprawdę się zmieniło, warto przyjrzeć się dwóm konkretnym zjawiskom, które najbardziej odczuwają właściciele stron internetowych i specjaliści SEO.

Zero-click searches i nowa rzeczywistość SERP

Zero-click searches, czyli wyszukiwania kończące się bez żadnego kliknięcia w wynik, nie są zjawiskiem nowym — istniały już wcześniej w postaci featured snippetów i paneli wiedzy. Jednak skala, jaką osiągnęły w 2025 i 2026 roku, jest bezprecedensowa. Według dostępnych danych ponad 58% wszystkich wyszukiwań w Google kończy się dziś bez kliknięcia w jakikolwiek link. Użytkownik otrzymuje odpowiedź bezpośrednio na stronie wyników — wygenerowaną przez AI na podstawie treści z różnych witryn — i po prostu zamyka przeglądarkę lub zadaje kolejne pytanie. Dla stron, które przez lata budowały ruch na prostych zapytaniach informacyjnych w stylu „co to jest inflacja" czy „jak zrobić naleśniki", oznacza to dramatyczny spadek odwiedzin. Tradycyjne wyniki organiczne zostają przesunięte coraz głębiej w dół strony — szacuje się, że o ponad 140% w stosunku do wcześniejszego położenia. Paradoks polega na tym, że ruch, który mimo wszystko trafia na strony cytowane przez AI, jest często wartościowszy niż standardowy ruch organiczny — użytkownicy przychodzący z odpowiedzi generatywnych mają silniejszą intencję zakupową i wyższe wskaźniki konwersji. Problem w tym, że aby w ogóle trafić do tej grupy, trzeba spełnić zupełnie inne wymagania niż te, które wystarczały do klasycznego pozycjonowania stron.

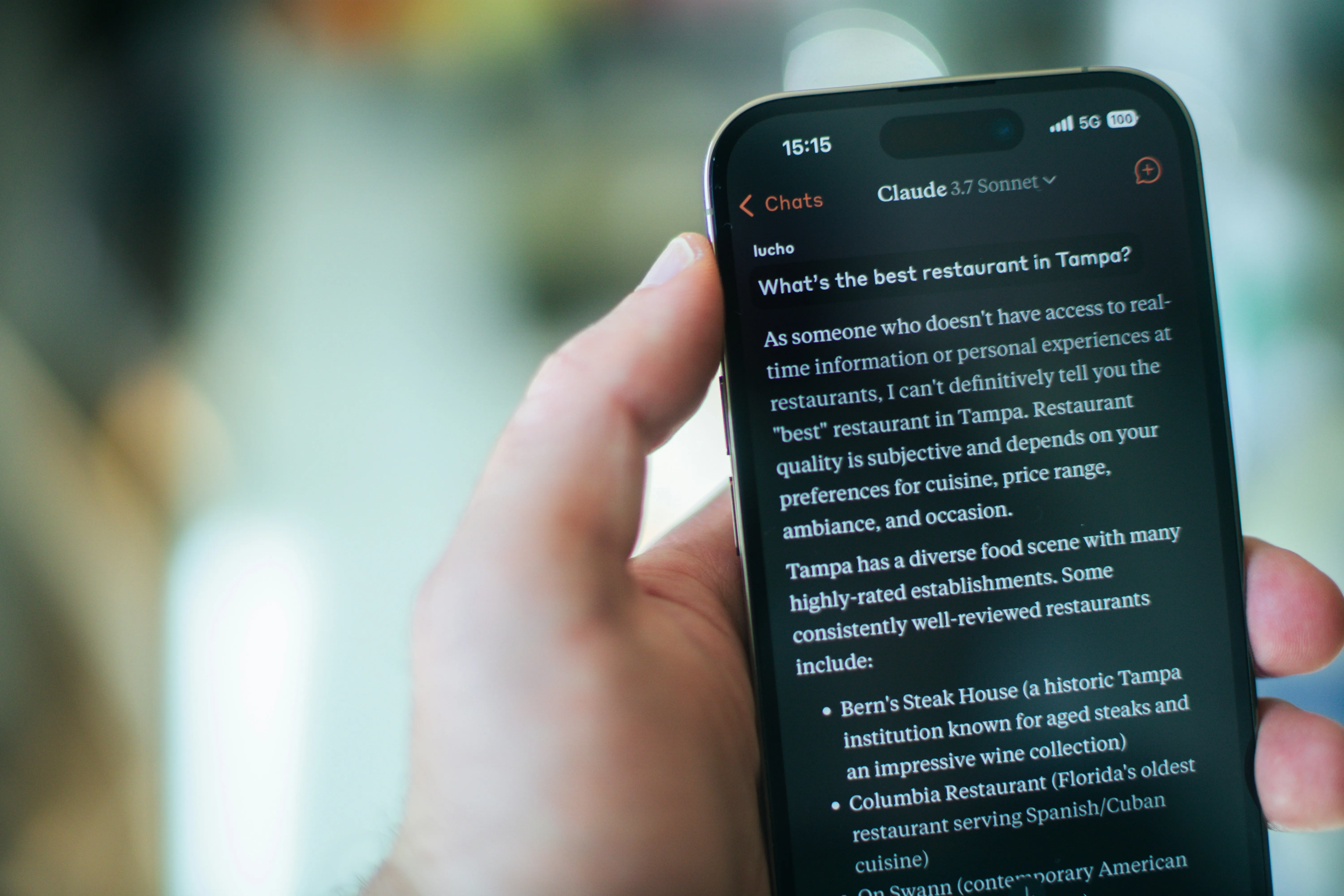

ChatGPT, Perplexity, Gemini — nowi gracze w wynikach wyszukiwania

Rewolucja nie ogranicza się wyłącznie do Google. Obok tradycyjnej wyszukiwarki wyrosły zupełnie nowe platformy, które użytkownicy traktują już nie jako ciekawostki, lecz jako pełnoprawne narzędzia do znajdowania informacji i podejmowania decyzji zakupowych. ChatGPT z funkcją wyszukiwania obsługuje dziś 800 milionów użytkowników tygodniowo. Perplexity, które pozycjonuje się wprost jako „wyszukiwarka odpowiedzi", przetwarza setki milionów zapytań miesięcznie. Gemini Google'a jest głęboko zintegrowany z całym ekosystemem usług firmy. Każda z tych platform działa inaczej i czerpie wiedzę z innych źródeł — co ma bezpośrednie przełożenie na to, które firmy i strony są w nich widoczne. Z analizy ponad 350 tysięcy lokalizacji i 2 751 marek wynika, że ChatGPT rekomenduje zaledwie 1,2% firm obecnych w lokalnych wynikach Google, Perplexity około 7,4%, a Gemini 11% — w porównaniu z 35,9% widoczności w tradycyjnym Local Pack Google. Co więcej, mniej niż połowa marek liderujących w klasycznym SEO pojawia się w odpowiedziach AI. To oznacza, że zbudowanie silnej pozycji w Google nie gwarantuje już żadnej widoczności tam, gdzie coraz więcej użytkowników faktycznie szuka — a firmy, które to ignorują, tracą realną przewagę konkurencyjną.

Czym jest GEO i dlaczego uzupełnia pozycjonowanie stron

Przez lata specjaliści SEO operowali w dość dobrze zdefiniowanym świecie: były czynniki rankingowe, były narzędzia do ich mierzenia i były techniki, które pozwalały na systematyczne poprawianie widoczności w Google. GEO, czyli Generative Engine Optimization, to odpowiedź branży na fakt, że ten świat przestał być jedynym, który ma znaczenie. Generative Engine Optimization to metodologia optymalizacji treści i obecności w sieci pod kątem silników generatywnych — czyli właśnie ChatGPT, Perplexity, Gemini czy Google AI Overviews. Nie chodzi tu o zastąpienie klasycznego pozycjonowania stron, lecz o jego rozszerzenie o nowy wymiar. Firma, która dziś inwestuje wyłącznie w tradycyjne SEO, jest jak sklep, który zadbał o witrynę od strony ulicy, ale zapomniał, że coraz więcej klientów wchodzi już przez zupełnie inne wejście. GEO wymaga innego myślenia o treściach, innego podejścia do struktury strony i innego rozumienia tego, czym jest „widoczność". Badania naukowe potwierdzają, że techniki GEO mogą zwiększyć widoczność treści w generatywnych odpowiedziach nawet o 40% — choć skuteczność różni się w zależności od branży i platformy. Żeby w pełni zrozumieć, dlaczego warto inwestować w GEO równolegle z SEO, trzeba najpierw zobaczyć, czym te dwa podejścia się różnią i według jakich kryteriów algorytmy AI decydują, czyje treści cytować.

SEO vs GEO — kluczowe różnice

Klasyczne pozycjonowanie stron skupia się przede wszystkim na sygnałach, które algorytm Google bierze pod uwagę przy ustalaniu rankingu: linkach przychodzących, technicznych parametrach strony, dopasowaniu treści do wpisywanych fraz czy szybkości ładowania. GEO operuje w innej logice — tutaj nie chodzi o to, żeby znaleźć się wyżej na liście wyników, lecz o to, żeby zostać wybranym jako źródło, z którego AI zbuduje swoją odpowiedź. Różnica jest fundamentalna. W SEO walczysz o pozycję. W GEO walczysz o cytowanie. Kluczowe różnice między oboma podejściami można ująć następująco:

- Słowa kluczowe vs kontekst i semantyka — SEO wymaga obecności konkretnych fraz w treści, GEO wymaga budowania pełnego kontekstu tematycznego i odpowiadania na pytania w sposób naturalny i wyczerpujący.

- Pozycja w rankingu vs cytowalność — w SEO mierzysz miejsce na liście wyników, w GEO mierzysz, jak często AI powołuje się na Twoje treści.

- Optymalizacja strony vs budowanie encji — GEO wymaga spójnej obecności marki w wielu miejscach w sieci, nie tylko na własnej stronie.

- Krótkie frazy vs pytania konwersacyjne — użytkownicy AI formułują zapytania jak zdania lub pytania, nie jak skróty wyszukiwarkowe.

- Ilość treści vs precyzja odpowiedzi — algorytmy generatywne preferują krótkie, zwięzłe sekcje odpowiadające dokładnie na jedno pytanie, a nie długie, ogólne artykuły.

Obie strategie mają wspólny mianownik — jakość i wiarygodność treści — ale droga do widoczności w każdym z tych środowisk wymaga osobnych działań i osobnych narzędzi pomiarowych.

Jak algorytmy AI wybierają źródła, które cytują

Analiza ponad 6,8 miliona cytowań AI przeprowadzona przez Yext przyniosła zaskakujące wyniki — 86% wszystkich cytowań w odpowiedziach generatywnych pochodzi ze źródeł kontrolowanych przez markę. Konkretnie: 44% to treści z własnych stron internetowych, 42% to listingi i profile w katalogach oraz platformach branżowych, 8% to opinie i media społecznościowe, a zaledwie 2% pochodzi z forów takich jak Reddit czy Quora — wbrew temu, co przez jakiś czas sugerowały niektóre opracowania. Co więcej, poszczególne platformy AI mają wyraźne preferencje co do źródeł: Gemini faworyzuje strony www (52,1% cytowań), ChatGPT opiera się głównie na listingach i katalogach (48,7%), a Perplexity czerpie z mieszanych źródeł, w tym z platform takich jak MapQuest czy TripAdvisor. Oznacza to, że firmy, które istnieją wyłącznie na własnej stronie internetowej — bez obecności w katalogach branżowych, bez opinii na wielu platformach, bez wzmianek w mediach — są przez algorytmy AI praktycznie niewidoczne, niezależnie od tego, jak dobrze wypozycjonowane są w klasycznym Google. Algorytmy generatywne szukają potwierdzenia wiarygodności w wielu miejscach jednocześnie i syntetyzują obraz firmy z wielu źródeł. Im spójniejszy i szerszy ten obraz, tym większa szansa na cytowanie.

Pozycjonowanie AI — co musisz zoptymalizować już dziś

Wiedza o tym, że AI zmienia zasady gry, to dopiero pierwszy krok. Ważniejsze jest pytanie praktyczne: co konkretnie zrobić, żeby Twoja strona była widoczna nie tylko w tradycyjnych wynikach Google, ale także w odpowiedziach generowanych przez ChatGPT, Perplexity czy Gemini? Pozycjonowanie AI nie jest abstrakcyjną teorią — to zestaw konkretnych działań technicznych i treściowych, które można wdrożyć systematycznie, niezależnie od wielkości strony czy branży. Część z nich pokrywa się z dobrymi praktykami klasycznego SEO, część wymaga zmiany myślenia i przebudowania dotychczasowego podejścia do tworzenia treści. Istotne jest to, że działania te wzajemnie się wzmacniają: dobrze napisana treść z właściwą strukturą działa lepiej, gdy uzupełnia ją schema markup, a schema markup przynosi pełne efekty, gdy strona jest postrzegana jako wiarygodny autorytet w swojej dziedzinie. Poniżej omawiamy trzy filary, na których powinno opierać się nowoczesne pozycjonowanie stron w erze generatywnych wyszukiwarek. Każdy z nich jest niezbędny — zaniedbanie któregokolwiek osłabia efektywność pozostałych. Nie chodzi o rewolucję w ciągu jednego dnia, lecz o świadome, konsekwentne budowanie obecności, którą algorytmy AI będą mogły rozpoznać, zrozumieć i zacytować.

Struktura treści i zasada „answer-first"

Algorytmy generatywne działają inaczej niż tradycyjne roboty indeksujące. Nie szukają strony z największą liczbą linków przychodzących — szukają fragmentu tekstu, który najlepiej i najszybciej odpowiada na konkretne pytanie użytkownika. Stąd wywodzi się zasada „answer-first": każda sekcja treści powinna zaczynać się od bezpośredniej odpowiedzi na pytanie, które ta sekcja adresuje, a dopiero potem rozwijać kontekst, przykłady i szczegóły. To odwrócenie tradycyjnej logiki dziennikarskiej odwróconej piramidy — tutaj najważniejsze informacje nie tylko są na górze, ale muszą być sformułowane w sposób, który AI może dosłownie wyciąć i wkleić jako odpowiedź.

Kilka praktycznych zasad budowania treści przyjaznych algorytmom generatywnym:

- Krótkie akapity — idealne są 2–4 zdania skupione na jednej myśli; długie bloki tekstu są trudniejsze do przetworzenia przez AI.

- Nagłówki jako pytania lub jednoznaczne twierdzenia — H2 i H3 powinny jasno sygnalizować, czego dotyczy dana sekcja, najlepiej w formie pytania (np. „Co to jest GEO?") lub konkretnego stwierdzenia.

- Sekcje FAQ — pytania i odpowiedzi to naturalny format dla algorytmów generatywnych; AI często bezpośrednio z nich korzysta przy budowaniu swoich odpowiedzi.

- Semantyczna różnorodność — zamiast wielokrotnie powtarzać tę samą frazę, używaj synonimów i powiązanych pojęć, które budują pełny kontekst tematyczny.

- Treści konwersacyjne — frazy w stylu „jak działa", „dlaczego warto", „co oznacza" naturalnie wpisują się w sposób, w jaki użytkownicy zadają pytania asystentom AI.

Warto też pamiętać o budowaniu klastrów tematycznych — skoordynowanych ekosystemów treści, gdzie strona główna (pillar page) jest uzupełniana przez artykuły satelitarne, powiązane wewnętrznymi linkami. Taka architektura wyraźnie sygnalizuje algorytmom, że strona jest autorytetem w danej dziedzinie, co zwiększa szansę na wielokrotne cytowania w różnych kontekstach.

Schema markup i dane strukturalne

Schema markup to jeden z tych elementów optymalizacji, który przez lata wielu właścicieli stron traktowało jako opcjonalne ulepszenie. W erze pozycjonowania AI staje się on elementem niemal obowiązkowym. Dane strukturalne w formacie JSON-LD dostarczają algorytmom — zarówno Google, jak i innym silnikom generatywnym — jednoznacznych, maszynowo czytelnych informacji o tym, czym jest dana strona, kto ją stworzył, czego dotyczy i jak wpisuje się w szerszy kontekst tematyczny. Google rekomenduje JSON-LD jako preferowany format implementacji ze względu na jego prostotę i separację od kodu HTML.

Najważniejsze typy schema, które warto wdrożyć w kontekście pozycjonowania AI:

- Article / BlogPosting — dla treści redakcyjnych i eksperckich, sygnalizuje algorytmom, że mają do czynienia z wartościowym materiałem.

- FAQ — bezpośrednio zwiększa szanse na pojawienie się w AI Overviews; pytania i odpowiedzi są chętnie cytowane przez modele generatywne.

- HowTo — dla treści instruktażowych i poradnikowych; algorytmy AI szczególnie chętnie korzystają z tego formatu przy odpowiedziach na pytania „jak to zrobić".

- Organization / Person — buduje tożsamość encji, czyli jasno komunikuje algorytmom, kim jest autor lub firma stojąca za treściami.

- LocalBusiness — kluczowy dla firm lokalnych; powinien zawierać pełne dane adresowe, godziny otwarcia, współrzędne geograficzne i zakres usług.

- Product i Review — dla e-commerce; dane o produkcie, cenie i ocenach klientów mogą pojawić się bezpośrednio w odpowiedziach generatywnych.

Kluczowa zasada: dane w schema muszą być spójne z informacjami widocznymi na stronie oraz we wszystkich zewnętrznych profilach firmy. Rozbieżności między schematem a rzeczywistą treścią są traktowane przez algorytmy jako sygnał nierzetelności i mogą obniżać cytowalność.

E-E-A-T i budowanie autorytetu encji

E-E-A-T — czyli Experience (Doświadczenie), Expertise (Wiedza ekspercka), Authoritativeness (Autorytet) i Trustworthiness (Wiarygodność) — to framework, który Google stosuje przy ocenie jakości treści, a algorytmy generatywne przejęły go jako jeden z głównych filtrów przy wyborze źródeł do cytowania. W praktyce oznacza to, że AI nie cytuje anonimowych stron z anonimowymi treściami — szuka autorów z udokumentowanym doświadczeniem, firm z weryfikowalną historią i źródeł potwierdzonych przez inne wiarygodne miejsca w sieci.

Budowanie autorytetu encji to proces długofalowy, ale można go prowadzić systematycznie:

- Strony autorów — każdy ekspert tworzący treści na stronie powinien mieć własną podstronę z biografią, doświadczeniem i linkami do zewnętrznych publikacji.

- Spójne wzmianki brandowe — nazwa firmy powinna pojawiać się w artykułach branżowych, wywiadach, lokalnych mediach i katalogach, zawsze w takiej samej formie.

- Panel wiedzy i Wikipedia — obecność w Google Knowledge Panel oraz, tam gdzie to możliwe, w Wikipedii znacząco wzmacnia rozpoznawalność encji przez modele językowe.

- Linki i wzmianki bez linków — w 2026 roku tzw. unlinked mentions, czyli wzmianki o marce bez aktywnego hiperłącza, mają dla widoczności w AI niemal taką samą wartość jak tradycyjne backlinki.

- Dokumentowanie źródeł — treści eksperckie powinny zawierać odniesienia do weryfikowalnych danych, badań i raportów; algorytmy AI analizują jakość źródeł przywoływanych przez daną stronę.

Szczególne znaczenie E-E-A-T ma w branżach YMYL (Your Money or Your Life) — czyli wszędzie tam, gdzie treści dotyczą finansów, zdrowia, prawa czy bezpieczeństwa. W tych obszarach algorytmy generatywne są wyjątkowo ostrożne przy wyborze źródeł i wyraźnie preferują strony z udokumentowanym autorytetem eksperckim.

Widoczność w AI a klasyczne czynniki rankingowe

Jednym z najczęstszych błędów, jakie popełniają firmy wdrażające strategie GEO, jest założenie, że pozycjonowanie AI to zupełnie osobny świat — niezwiązany z tym, co do tej pory robiły w klasycznym SEO. Rzeczywistość jest bardziej złożona i — co ważne — bardziej optymistyczna dla tych, którzy mają już solidne fundamenty. Wiele czynników, które od lat wpływają na widoczność w tradycyjnych wynikach wyszukiwania, ma bezpośrednie przełożenie na cytowalność w odpowiedziach generatywnych. Różnica polega na wadze poszczególnych sygnałów i sposobie, w jaki algorytmy AI je interpretują. O ile w klasycznym SEO linki przychodzące były przez lata dominującym czynnikiem rankingowym, o tyle algorytmy generatywne przykładają równie dużą wagę do spójności danych, wiarygodności opinii czy dostępności treści dla crawlerów AI. Innymi słowy: zaniedbanie któregokolwiek z tych elementów może sprawić, że firma świetnie widoczna w Google Local Pack będzie zupełnie nieobecna w odpowiedziach ChatGPT czy Perplexity. Warto też pamiętać, że algorytmy AI nie działają w próżni — korzystają z tych samych zasobów internetowych, które indeksuje Google, tyle że filtrują je według innych kryteriów. Dlatego zamiast myśleć o SEO i GEO jako o dwóch oddzielnych strategiach wymagających oddzielnych budżetów, lepiej traktować je jako dwie warstwy tej samej inwestycji w widoczność online.

Poniżej najważniejsze klasyczne czynniki, które mają bezpośredni wpływ na widoczność w AI — i na co warto zwrócić szczególną uwagę:

Opinie i oceny jako filtr, nie sygnał rankingowy

Algorytmy generatywne traktują opinie inaczej niż Google w Local Pack. Dla AI opinie to przede wszystkim filtr wiarygodności — firmy z niską średnią oceną lub zbyt małą liczbą recenzji są po prostu pomijane przy generowaniu odpowiedzi, niezależnie od innych sygnałów. Z danych wynika, że lokalizacje rekomendowane przez ChatGPT mają średnio 4,3 gwiazdki, a przez Perplexity — 4,1. Co istotne, liczy się nie tylko Google, ale też opinie na Facebooku, platformach branżowych i innych serwisach — AI analizuje szeroki obraz firmy z wielu źródeł jednocześnie. Kluczowe zasady:

- regularność pozyskiwania opinii jest ważniejsza niż ich łączna liczba,

- świeże recenzje mają większą wagę niż te sprzed roku,

- odpowiadanie na każdą opinię — pozytywną i negatywną — buduje sygnał aktywności i wiarygodności,

- naturalny język recenzji z organicznymi wzmiankami o usługach wzmacnia kontekst tematyczny firmy w oczach AI.

Spójność danych NAP i cytowania

NAP, czyli Name, Address, Phone — spójność tych danych we wszystkich miejscach, gdzie firma jest wymieniona w sieci, to fundament widoczności zarówno w klasycznym local SEO, jak i w pozycjonowaniu AI. Cytowania stanowią około 13% czynników widoczności AI według Whitespark Local Search Ranking Factors 2026 — to więcej niż ich udział w tradycyjnym Local Pack. Nawet drobne rozbieżności, takie jak różne skróty nazwy ulicy czy nieaktualny numer telefonu, osłabiają sygnał i mogą sprawić, że algorytm uzna dane firmy za niewiarygodne. Warto zadbać o:

- identyczne dane NAP na stronie, w Google Business Profile, Apple Maps, Bing Places i we wszystkich katalogach branżowych,

- obecność w katalogach niszowych specyficznych dla danej branży i regionu — mają wyższą wartość niż ogólne agregatory,

- regularne audyty spójności danych, szczególnie po zmianach adresu, numeru telefonu czy nazwy firmy.

Dostęp dla crawlerów AI — robots.txt i llms.txt

To element często pomijany, a mający fundamentalne znaczenie: żeby AI mogła zacytować treści ze strony, musi mieć do nich dostęp. Crawlery głównych platform AI — GPTBot (ChatGPT), ClaudeBot (Claude), PerplexityBot, Google-Extended, Applebot-Extended — muszą być jawnie dopuszczone w pliku robots.txt. Blokowanie ich, nawet niecelowe, skutkuje całkowitą niewidocznością w odpowiedziach generatywnych danej platformy. Uzupełnieniem robots.txt jest nowy standard — plik llms.txt — który wskazuje algorytmom AI, jak interpretować i cytować treści na stronie. Robots.txt kontroluje dostęp, llms.txt dostarcza kontekstu — oba działają warstwowo i wzajemnie się uzupełniają. Lista crawlerów AI, których dostęp warto zweryfikować:

- GPTBot — ChatGPT / OpenAI,

- ChatGPT-User — ChatGPT browsing,

- ClaudeBot — Anthropic / Claude,

- PerplexityBot — Perplexity,

- Google-Extended — Google AI / Gemini,

- Applebot-Extended — Apple Intelligence.

Blokowanie któregokolwiek z tych botów w robots.txt to jeden z najpoważniejszych błędów, jakie można popełnić w strategii pozycjonowania AI — i jeden z najłatwiejszych do naprawienia.

Pomiar efektów w erze generatywnego wyszukiwania

Jednym z największych wyzwań, przed którymi stają dziś specjaliści SEO i właściciele stron, jest odpowiedź na pozornie proste pytanie: skąd wiedzieć, czy działania GEO przynoszą efekty? Klasyczne pozycjonowanie stron miało w tym względzie komfortową sytuację — pozycja w rankingu była mierzalna, liczba kliknięć policzalna, a ROI można było oszacować z rozsądną precyzją. W erze generatywnego wyszukiwania ta przejrzystość znika. Użytkownik, który otrzymał odpowiedź od AI i na jej podstawie podjął decyzję zakupową, często nigdy nie kliknął w żaden link — a mimo to Twoja firma odegrała rolę w tym procesie. Tradycyjne narzędzia analityczne tego nie rejestrują. Co więcej, nawet gdy użytkownik trafi na stronę z odpowiedzi AI, źródło ruchu może być w Google Analytics 4 błędnie przypisane do kategorii „direct" zamiast do platformy generatywnej. To sprawia, że bez świadomego dostosowania systemu pomiarowego można działać w ciemno — inwestować w GEO i nie widzieć efektów tylko dlatego, że mierzy się je niewłaściwymi narzędziami. Dobre wieści są takie, że ekosystem narzędzi do mierzenia widoczności w AI rozwija się bardzo szybko i dziś jest już czym mierzyć — pod warunkiem, że wie się, czego szukać i gdzie patrzeć. Poniżej zestawienie kluczowych metryk i narzędzi, które warto włączyć do swojego systemu analitycznego.

Nowe metryki — czego nie mierzy Search Console

Google Search Console pozostaje nieocenionym narzędziem, ale ma swoje ograniczenia w kontekście pozycjonowania AI. Nie rejestruje cytowań w odpowiedziach generatywnych, nie śledzi widoczności w ChatGPT ani Perplexity i nie informuje o tym, jak często marka pojawia się w odpowiedziach AI bez bezpośredniego kliknięcia. Warto jednak wiedzieć, że Search Console można wykorzystać w nieoczywisty sposób do wykrywania śladów wyszukiwań wspomaganych przez AI — zapytania składające się z siedmiu lub więcej słów (możliwe do filtrowania przez regex (bw+bs){7,}) często wskazują na konwersacyjny styl charakterystyczny dla interakcji z AI. Nowe metryki, które powinny znaleźć się w każdym nowoczesnym dashboardzie SEO/GEO:

- Cytowania w AI — jak często i w jakim kontekście modele generatywne powołują się na treści lub markę,

- Share of voice w AI — jaki procent odpowiedzi na zapytania z danej branży zawiera wzmiankę o firmie w porównaniu z konkurencją,

- Sentyment wzmianek — czy AI przedstawia markę pozytywnie, neutralnie czy negatywnie,

- Wzrost wyszukiwań brandowych — rosnąca liczba wyszukiwań nazwy firmy to pośredni dowód na rosnącą rozpoznawalność budowaną przez AI,

- Ruch referral z platform AI — w GA4 warto skonfigurować filtr regex obejmujący domeny takie jak chatgpt.com, perplexity.ai, gemini.google.com, claude.ai, copilot.microsoft.com,

- Jakość ruchu z AI — czas na stronie, współczynnik konwersji i głębokość sesji dla użytkowników przychodzących z platform generatywnych; dane wskazują, że ten ruch konwertuje często lepiej niż tradycyjny ruch organiczny.

Narzędzia do monitorowania widoczności w AI

Rynek narzędzi GEO jest młody, ale już teraz oferuje rozwiązania pozwalające na systematyczne śledzenie obecności w odpowiedziach generatywnych. Oto przegląd najbardziej użytecznych:

- LLMrefs — monitoruje cytowania marki w odpowiedziach AI, pokazuje share of voice i sentyment; jedno z bardziej rozbudowanych narzędzi dostępnych na rynku,

- Geoptie — platforma dedykowana GEO, pozwala śledzić widoczność w wielu modelach AI jednocześnie,

- seoClarity — rozbudowane narzędzie SEO z modułem monitorowania AI Overviews i widoczności w odpowiedziach generatywnych,

- CoreMention — śledzi wzmianki o marce w odpowiedziach AI, przydatne szczególnie dla firm lokalnych i regionalnych,

- Google Search Console — uzupełniająco, do analizy zapytań konwersacyjnych i zmian widoczności fraz po wdrożeniu działań GEO,

- Google Analytics 4 — z właściwą konfiguracją segmentów i filtrów pozwala izolować ruch pochodzący z platform AI i analizować jego jakość osobno od pozostałego ruchu organicznego.

Regularny audyt widoczności w AI powinien obejmować nie tylko monitorowanie cytowań, ale też weryfikację poprawności danych prezentowanych przez algorytmy — czy AI podaje aktualny adres, telefon i godziny otwarcia, jak opisuje ofertę firmy i czy rekomenduje ją na tle konkurencji. Błędne dane w odpowiedziach AI mogą skutkować utratą klientów, którzy nigdy nie dotrą na stronę, żeby je zweryfikować.

Podsumowanie

Pozycjonowanie stron w 2026 roku to już nie tylko walka o miejsce w rankingu Google. To budowanie wielowarstwowej obecności w ekosystemie, w którym decyzje zakupowe coraz częściej zapadają w odpowiedziach generowanych przez AI — zanim użytkownik w ogóle trafi na jakąkolwiek stronę internetową. Firmy, które traktują SEO i GEO jako dwie oddzielne strategie, ryzykują, że zainwestują dużo w jedną warstwę widoczności, całkowicie zaniedbując drugą. Tymczasem najskuteczniejsze podejście to integracja obu perspektyw — klasyczne pozycjonowanie stron dostarcza fundamentów, na których GEO może w pełni działać.

Artykuł sponsorowany